On soigne souvent l’esthétique d’une interface comme on choisirait la couleur des murs d’un salon, mais ce qui plaît à l’œil n’est pas toujours ce qui convertit. Un design élégant peut séduire son créateur, il ne convainc pas forcément l’internaute pressé. Entre les intuitions graphiques et les comportements réels, il y a souvent un fossé. L’a/b testing permet de le combler, en remplaçant les goûts personnels par des données brutes. Fini le tirage au sort entre deux boutons d’appel à action : on mesure, on compare, on décide. Et c’est souvent la version la moins « jolie » qui remporte tous les suffrages.

L’art de l’expérimentation : pourquoi tester avant de valider ?

Combien de fois avez-vous vu un projet bloqué par un débat sans fin : “Moi, je préfère cette police”, “Non, le vert attire plus l’œil” ? Ces discussions, aussi passionnées soient-elles, reposent sur des opinions. Or, le web n’est pas un salon d’art. Il se mesure en clics, en inscriptions, en ventes. Un simple changement de libellé sur un bouton - par exemple, passer de “En savoir plus” à “Commencer gratuitement” - peut augmenter les conversions de plus de 30 %. Ce n’est pas une hypothèse, c’est une observation récurrente dans les tests A/B.

Pour transformer durablement vos performances de conversion, il est judicieux de mettre en place une stratégie d'ab testing rigoureuse. Cette méthode repose sur un principe simple : on ne change qu’un seul élément à la fois, on répartit le trafic aléatoirement entre deux versions (A et B), et on laisse les données parler. C’est une approche scientifique appliquée au marketing digital. Elle évite les biais cognitifs, comme la tendance à surévaluer ses propres idées, et recentre l’équipe sur un objectif unique : l’expérience utilisateur optimisée.

Les 5 variables clés à modifier pour booster vos conversions

Quels éléments ont l’impact le plus fort sur l’engagement ?

Certains composants d’une page ont un effet disproportionné sur les décisions des visiteurs. Modifier ces leviers peut générer des gains significatifs, même avec des ajustements mineurs. Voici une sélection des variables les plus influentes, analysées selon leur potentiel d’impact et la facilité de mise en œuvre.

| 🎯 Élément | 📊 Impact potentiel | 🛠️ Facilité de mise en œuvre |

|---|---|---|

| CTA (Call to Action) - texte, couleur, taille, position | Élevé | Facile |

| Titres et accroches - longueur, ton, formulation | Élevé | Facile |

| Formulaires - nombre de champs, libellés, labels, pré-cochage | Élevé | Moyen |

| Images et visuels - style, contenu, position, taille | Moyen | Facile |

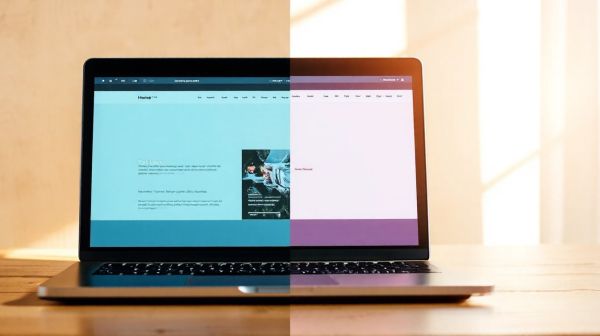

| Layout - structure des sections, hiérarchie visuelle, espacement | Moyen à Élevé | Complexe |

Maîtriser la durée et la fiabilité de vos tests

Atteindre la signification statistique

Un test A/B n’est pas une course de vitesse. Il faut du temps pour collecter suffisamment de données et atteindre une signification statistique fiable - généralement fixée à 95 %. Cela signifie qu’il y a 95 % de chances que la différence observée entre les deux versions ne soit pas due au hasard. En dessous, les conclusions sont fragiles, voire trompeuses.

La durée idéale d’un test varie entre 2 et 6 semaines, selon plusieurs facteurs. Le volume de trafic est le plus déterminant : plus vous avez de visiteurs, plus vite vous obtenez des résultats exploitables. Avec environ 1 000 visiteurs par jour, un test bien ciblé peut aboutir en deux à trois semaines. Mais attention au “peeking” : consulter les résultats trop tôt, dès que la version B semble gagner, peut fausser l’analyse. Il faut laisser le temps à la courbe de se stabiliser, surtout si votre trafic varie selon les jours de la semaine.

Bâtir une roadmap d'amélioration continue

Prioriser selon l'impact potentiel

On ne peut pas tout tester en même temps. L’efficacité d’une stratégie d’optimisation repose sur la capacité à prioriser. Une grille simple, croisant l’impact potentiel et la facilité de mise en œuvre, permet de classer les tests par ordre d’intérêt. Par exemple, changer le libellé d’un bouton a souvent un impact fort et demande peu de ressources - c’est un “quick win”. En revanche, repenser entièrement la navigation du site est lourd à mettre en œuvre, même s’il peut offrir des gains à long terme.

Impliquer les équipes transversales dès le départ est crucial. Marketing, développement, data et UX doivent collaborer pour formuler des hypothèses réalistes et interpréter les résultats. Un test isolé, mené sans cette synergie, risque d’être ignoré ou mal intégré.

Analyser le gain financier réel

Le taux de conversion est un excellent indicateur, mais il ne raconte pas toute l’histoire. Une variante peut augmenter le nombre de clics, mais attirer des utilisateurs moins engagés - ce qui réduit le panier moyen. C’est pourquoi il est essentiel de croiser les données de conversion avec la valeur moyenne des commandes ou des leads générés. Ce croisement permet d’évaluer le véritable gain financier de la version gagnante. C’est ce chiffre-là qui convainc les décideurs.

Checklist pour un test réussi du premier coup

De l'hypothèse au lancement

Tout bon test commence par une hypothèse claire. Pas “je pense que c’est mieux”, mais “je suppose que remplacer ‘Inscrivez-vous’ par ‘Commencez gratuitement’ augmentera le taux d’inscription car cela réduit la perception de risque”. Cette formulation précise guide la conception de la variante et l’analyse finale. Ensuite, on s’assure de ne modifier qu’un seul élément à la fois. Sinon, impossible de savoir ce qui a fait la différence.

Configuration et segmentation

Techniquement, il faut bien segmenter le trafic : chaque visiteur voit soit la version A, soit la version B, de manière aléatoire. Certains outils permettent d’ajuster la répartition (70/30, par exemple), mais dans la majorité des cas, un partage 50/50 est recommandé pour garantir l’équité. Attention aussi aux segments spécifiques : on peut vouloir tester une variante uniquement sur les nouveaux visiteurs, ou selon la provenance du trafic (mobile, desktop, réseaux sociaux). Enfin, les outils de test ont un coût : ils démarrent autour de 50 €/mois pour les solutions d’entrée de gamme, mais peuvent grimper rapidement avec les fonctionnalités avancées.

- 🎯 Définir un objectif mesurable (ex. : +10 % de conversions)

- 🧪 Formuler une hypothèse claire et testable

- 🛠️ Créer une variante avec un seul changement

- ⚙️ Configurer le test avec un trafic aléatoire et équilibré

- 📊 Suivre les résultats jusqu’à significativité statistique (≥95 %)

Les demandes courantes

Est-il préférable de tester un bouton rouge ou un bouton bleu sur une interface sombre ?

La couleur idéale dépend surtout du contraste avec l’arrière-plan. Sur un fond sombre, un bouton rouge peut capter l’attention, mais un bleu vif ou un vert clair peut être tout aussi efficace. L’essentiel est de garantir une bonne visibilité et une hiérarchie claire, plutôt que de miser sur une couleur “gagnante” par défaut.

Peut-on réaliser des tests sur un site qui reçoit moins de 100 visites par jour ?

Oui, mais les délais s’allongent considérablement. Avec un faible trafic, il faut parfois plusieurs mois pour atteindre une significativité statistique. Dans ce cas, on privilégie les tests qualitatifs (retours utilisateurs, heatmaps) ou on se concentre sur des pages à fort impact, comme la page de paiement.

Quels sont les frais annexes à prévoir en dehors de l'abonnement à un logiciel de test ?

Au-delà de l’outil, il faut compter le temps de conception des variantes (design, rédaction) et éventuellement des développements techniques pour intégrer les modifications. Ces coûts internes sont souvent sous-estimés, mais ils peuvent peser lourd dans la balance.

Comment implémenter définitivement la version gagnante sans surcharger le code ?

Une fois le test terminé, il est crucial de supprimer le script de test du site. Laisser ce code en place ralentit le chargement des pages. On intègre proprement la version gagnante dans la base du site, puis on retire toute trace de l’expérimentation pour préserver la performance.

Le RGPD impose-t-il des contraintes spécifiques lors du suivi des variantes ?

Oui, les tests A/B reposent souvent sur le dépôt de cookies pour suivre les utilisateurs. Or, le RGPD exige un consentement clair. Il faut donc informer les visiteurs via un bandeau de gestion des cookies, en précisant que des tests d’expérience sont réalisés, et leur permettre de s’y opposer.